Quand on parle d’IA et de PV, on pense d’abord à la transcription. Mais, sur le terrain, le point le plus délicat est souvent ailleurs : l’attribution des propos. Une transcription parfaite sans les bons noms peut devenir une source de corrections infinies — et un carburant à tensions (“ce n’est pas moi”, “ce n’est pas ce que j’ai dit”).

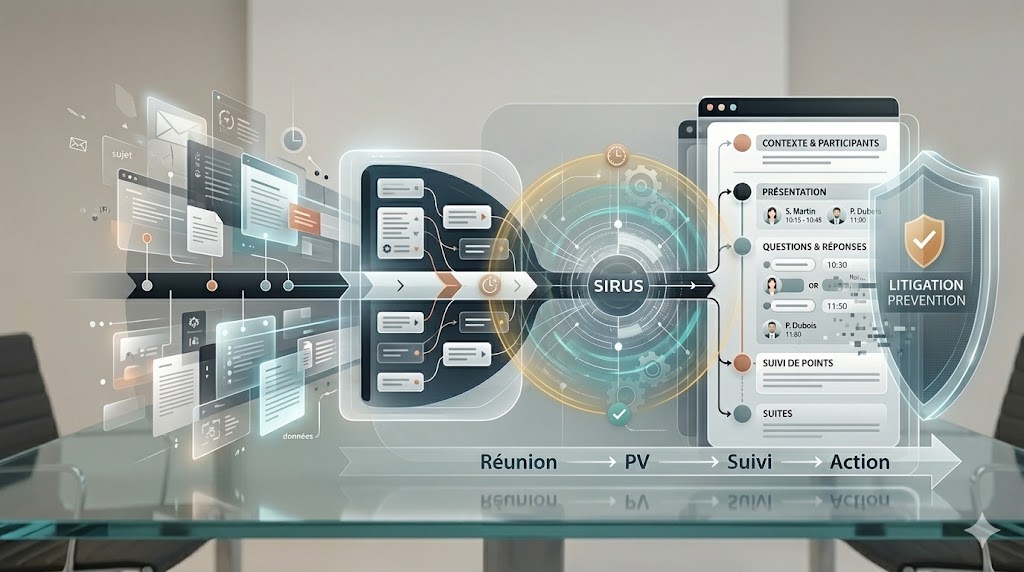

SIRUS décrit un mécanisme d’étalonnage de la voix (enregistrement court) pour détecter automatiquement les intervenants lors des réunions suivantes, en précisant que la personnalisation avec les noms dépend aussi de la clarté de l’audio et du contexte (écho, bruit, etc.). C’est une approche pragmatique : l’identification des voix n’est pas un bouton magique, c’est une méthode.

? La promesse réaliste : réduire la friction, pas supprimer toute relecture

Même avec un bon système, des situations restent difficiles :

• personnes qui se coupent la parole,

• participants à distance avec un son compressé,

• salles réverbérantes,

• nouveaux intervenants non étalonnés.

Le bénéfice attendu est donc : gagner du temps sur l’attribution, puis laisser la relecture humaine sécuriser les zones ambiguës.

? La méthode qui fonctionne : préparer la liste des participants

L’identification des intervenants tient beaucoup à la préparation :

• liste des présents (noms, prénoms, fonctions),

• constance des prises de parole (micro, emplacement),

• règles simples en séance (se présenter, parler à tour de rôle sur les votes et annonces).

SIRUS insiste d’ailleurs sur la nécessité de connaître la composition précise des participants : c’est un point clé, souvent sous-estimé.

? Pourquoi c’est critique pour le PV “officiel”

Un PV “officiel avec noms” est plus lisible et souvent plus utile : il structure les responsabilités et les réponses. Mais il est aussi plus exposé à la contestation si un propos est attribué à tort. D’où l’intérêt d’un duo :

• identification assistée,

• extraction par intervenant + relecture ciblée.

✅ À retenir

“Qui parle” est souvent plus difficile que “quoi est dit”.

Étalonnage + préparation participants + audio propre = gains réels.

La validation humaine reste indispensable sur les passages sensibles.